سال ۲۰۲۵ برای هالیوود سالی بود که «هوش مصنوعی مولد» از حاشیهی اتاقهای تدوین بیرون آمد و مستقیم روی میز تصمیمگیری نشست—اما نه با یک شاهکار سینمایی، نه با یک جهش فناورانهی واقعاً کاربردی. نتیجه بیشتر شبیه موجی از ویدئوهای پرزرقوبرق اما کمجان بود؛ محصولاتی که در بهترین حالت برای میم و کلیپهای کوتاه جواب میدهند و در بدترین حالت، استانداردهای تولید را پایین میکشند. با وجود سرمایهگذاریهای سنگین، هنوز پروژهای که بتواند بهطور قانعکننده نشان دهد این همه هیاهو برای صنعت فیلم و سریال «ارزش واقعی» دارد، به چشم نمیآید.

هوش مصنوعی در هالیوود تازهوارد نیست؛ این بار اما همهچیز عوض شد

استفاده از الگوریتمها در هالیوود سابقه دارد. سالهاست ابزارهای مبتنی بر یادگیری ماشین در پستولید (Post-Production) نقش دارند: از جوانسازی دیجیتال بازیگران (de-aging) گرفته تا حذف پردهی سبز، پاکسازی نویز، روتوسکوپی و تسریع برخی مراحل جلوههای ویژه (VFX). این بخش از فناوری—وقتی درست و محدود به کارهای تکراری و زمانبر باشد—میتواند مثل یک «ابزار کمکی» به هنرمندان انسانی خدمت کند.

اما آنچه در ۲۰۲۵ پررنگ شد، چرخش صنعت به سمت نسل تازهای از «هوش مصنوعی مولد» بود که عمدتاً با متن، ویدئو تولید میکند (text-to-video). این مدلها معمولاً با انبوه دادههای تصویری و ویدئویی آموزش میبینند و سپس با یک چند جملهی توصیفی، ویدئوهایی تولید میکنند که از نظر ظاهری ممکن است جذاب باشند، اما اغلب با مشکلات بنیادی روبهرو هستند: فیزیک ناپایدار، تداوم (continuity) ضعیف، جزئیات نادرست، و مهمتر از همه، نبود کنترل دقیق کارگردانی.

این همان نقطهای است که بسیاری از متخصصان تولید میپرسند: اگر خروجی قابل تکرار، قابل کنترل و قابل ادغام در خط تولید استاندارد نیست، چرا باید جایگزین روشهای اثباتشده شود؟

از دادگاه تا قرارداد: چطور شکایتها به «همکاری» تبدیل شد

ابتدای این همنشینی چندان دوستانه نبود. استودیوها در موقعیت مناسبی قرار داشتند تا شرکتهای سازندهی مدلهای ویدئویی را بهدلیل آموزش بر آثار دارای کپیرایت به دادگاه بکشانند—اتهامی که از نظر حقوق مالکیت فکری (IP) در آمریکا و اروپا بسیار جدی است. نامهایی مثل دیزنی، یونیورسال و وارنر برادرز دیسکاوری در سالهای اخیر بارها وارد منازعات حقوقی مشابه شدهاند و در ۲۰۲۵ هم شکایتها و تهدیدها ادامه داشت.

با این حال، بهجای ادامهی مسیر تقابل تا انتها، بخشی از بزرگترین بازیگران ترجیح دادند وارد فاز «همکاری و مجوزدهی» شوند. این چرخش پیام روشنی داشت: اگر قرار است موج هوش مصنوعی مولد متوقف نشود، برخی استودیوها میخواهند سهم خود را از آن، چه به شکل درآمد و چه به شکل کنترل بازار، تضمین کنند. اما منتقدان میگویند همین تصمیم، راه را برای عصر تولید محتوای بیکیفیت و انبوه—چیزی که در فضای آنلاین به آن «اسلاپ» (Slop) میگویند—هموارتر میکند.

استارتاپها و وعدههای بزرگ: «تولید ارزان» به قیمت چه چیزی؟

در کنار غولهایی مثل گوگل و OpenAI، سال ۲۰۲۵ شاهد حضور پر سر و صدای شرکتهای کوچکتر هم بود؛ بازیگرانی که تلاش کردند برای خودشان صندلیای در میز سرگرمی پیدا کنند. نمونهی شاخص، Asteria بود؛ استارتاپی که با محوریت توسعه پروژههای سینمایی و تکیه بر مدلهای تولید ویدئو با ادعای «اخلاقمحور» مطرح شد. هدف اعلامی چنین شرکتهایی معمولاً این است: مدلها را طوری مهندسی کنیم که هم از نظر حقوقی کمریسک باشند و هم از نظر فنی برای تولید حرفهای مفید.

اما مشکل اینجا بود که بسیاری از این وعدهها در سطح بیانیه و تبلیغ باقی ماند. پروژهی نخست Asteria بیش از آنکه چیزی ملموس به مخاطب نشان دهد، به موجی از هایپ شبیه بود. از طرف دیگر، پلتفرمهایی مثل Showrunner (با پشتیبانی آمازون) ایدهای را جلو بردند که در نگاه اول جذاب به نظر میرسد: کاربر چند جمله در دیسکورد مینویسد و یک «نمایش انیمیشنی» تحویل میگیرد. با این حال، خروجیها غالباً شتابزده، کمجان و شبیه کپیهای ارزان از آثار ساختهشده توسط انیماتورهای واقعی بودند—محصولی که بیشتر به یک دموی آزمایشگاهی میمانَد تا یک تجربه سرگرمی.

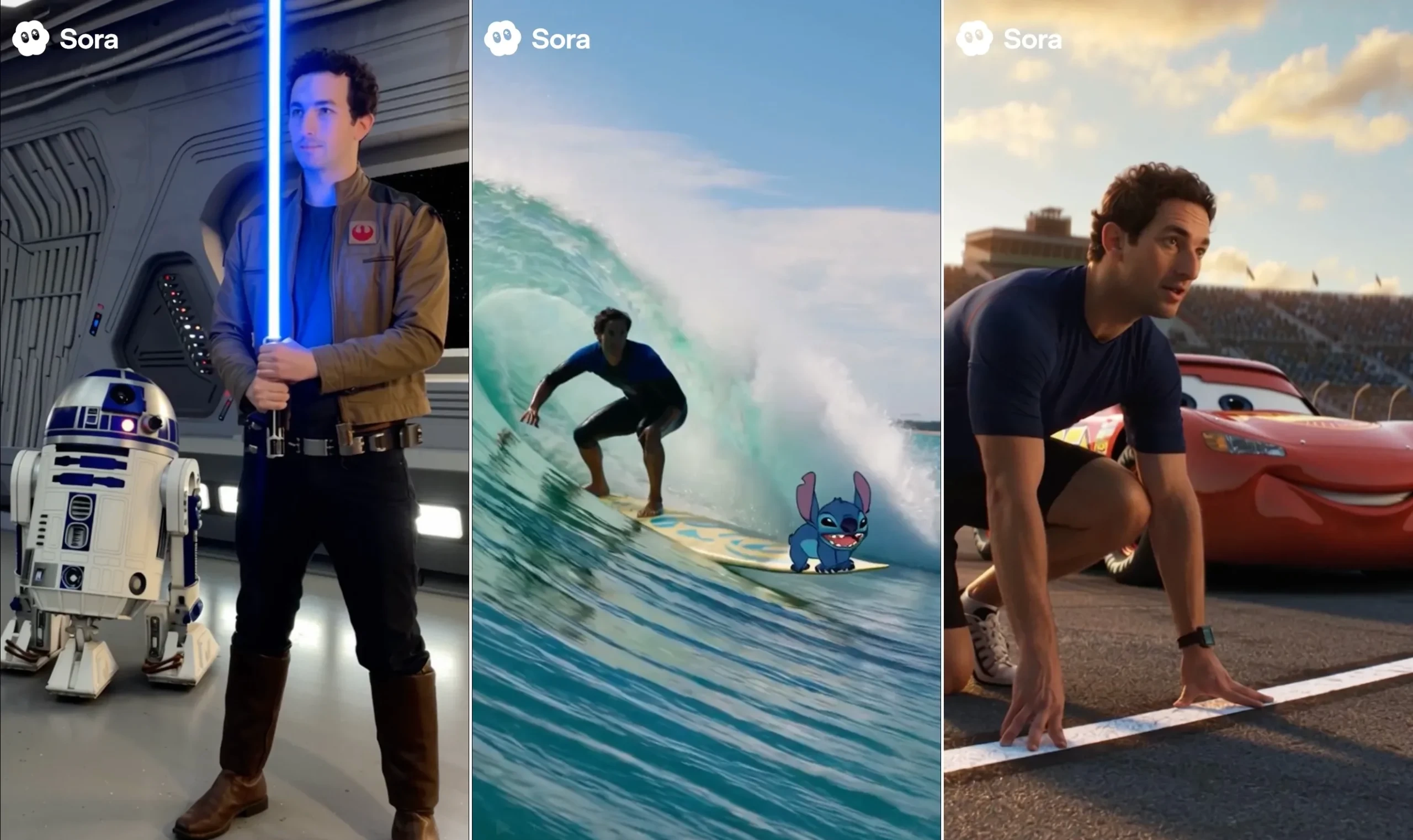

در چنین مدل کسبوکاری، بدبینها یک هدف پنهان میبینند: نه جذب مخاطب عام، بلکه رسیدن به قراردادهای همکاری با استودیوهای بزرگ تا فناوری تولید «محتوای سفارشی» (bespoke content) با شخصیتهای مشهور فرنچایزها در پلتفرمها ادغام شود. یعنی کاربر با چند پرامپت، ویدئویی با شخصیتهای آشنا بسازد—اما با کیفیتی که معلوم نیست تا چه حد قابل دفاع خواهد بود.

وقتی دیزنی هم وارد بازی شد: مجوز میلیارددلاری برای ویدئوی مولد

ایدهی تولید ویدئو با متن، مدتها شبیه یک سرگرمی اینترنتی به نظر میرسید: برای کلیپهای کوتاه، شوخیهای تصویری یا میمهای روز. اما در ۲۰۲۵ نشانههایی ظاهر شد که برخی استودیوهای بزرگ میخواهند همین «کیفیت میمی» را به قلمرو رسمی سرگرمی بکشانند—یا دستکم، آن را آزمایش کنند.

یکی از بحثبرانگیزترین نمونهها، قرارداد مجوزدهی چندساله و بسیار بزرگ دیزنی با OpenAI بود؛ توافقی که طبق گزارشها به کاربران ابزار Sora اجازه میدهد ویدئوهایی مبتنی بر هوش مصنوعی با دسترسی به حدود ۲۰۰ شخصیت از جهانهای پرطرفداری مثل جنگ ستارگان (Star Wars) و مارول بسازند. از منظر بازاریابی، این تصمیم میتواند انفجاری از محتوای تولیدشده توسط کاربر (UGC) را به راه بیندازد. اما از منظر کیفیت و کنترل برند، سوالهای سختی مطرح میشود: آیا مخاطب واقعاً «محتوای سفارشیِ بیثبات» را به محتوای حرفهای ترجیح میدهد؟ و مهمتر: اگر تولید انبوه ساده شود، چطور از غرق شدن پلتفرمها در سیل ویدئوهای بیکیفیت جلوگیری میکنند؟

نتفلیکس و آمازون: آزمایشهای پرهزینه با خروجیهای کماعتبار

نتفلیکس از نخستین بازیگران بزرگی بود که با افتخار درباره استفاده از هوش مصنوعی مولد صحبت کرد. پس از بهکارگیری این فناوری در بخشی از جلوههای ویژه یکی از سریالهایش، مجموعهای از دستورالعملهای کلی برای شرکای تولیدی منتشر کرد؛ دستورالعملهایی که گرچه الزامآور نبودند، اما پیام اقتصادیشان روشن بود: کاهش هزینههای VFX یکی از انگیزههای اصلی حمایت از این روند است.

آمازون نیز مسیر مشابهی رفت، اما یکی از پر سروصداترین شکستهای سال را رقم زد: انتشار چند سریال انیمه ژاپنی با دوب (دوبله) تولیدشده توسط هوش مصنوعی—بدون مشارکت مترجمان انسانی یا گویندگان حرفهای. نتیجه برای بسیاری از مخاطبان، دوبهایی با لحن نامتناسب، ترجمههای نادقیق و احساس مصنوعی بود؛ نمونهای که نشان داد «مدل زبانی» ممکن است معنی را منتقل کند، اما انتقال ظرافتهای فرهنگی، ریتم اجرا و بازی صوتی را تضمین نمیکند.

مشکل فقط دوب نبود. قابلیت خلاصهسازی خودکار اپیزودها و بازگویی داستان (AI recaps) نیز بارها جزئیات سریالها را اشتباه گزارش کرد؛ خطایی که اعتماد مخاطب را به سرعت فرسوده میکند. این دو تجربه نشان دادند وقتی کنترل کیفی (QA) و نظارت انسانی کمرنگ شود، هوش مصنوعی مولد میتواند با اطمینان بالا، خروجی غلط تولید کند—پدیدهای که در علوم داده به «توهم مدل» (hallucination) نزدیک است، هرچند در زمینه ویدئو و روایت، اثرش بیشتر شبیه خرابکاری در تجربه تماشاست.

آمازون ناچار شد بخشی از این قابلیتها را جمع کند، اما نکته نگرانکننده برای منتقدان این بود که شرکتها معمولاً نمیگویند «دیگر هرگز»؛ فقط میگویند «فعلاً نه». یعنی احتمال تکرار، با نسخهای جدیدتر و شاید پرریسکتر، همچنان وجود دارد.

چرا خروجیها «اسلاپ» به نظر میرسند؟

برای درک اینکه چرا بسیاری از تولیدات هوش مصنوعی مولد در ۲۰۲۵ سطحی یا ناپخته دیده میشوند، باید کمی به محدودیتهای فنی نگاه کنیم. مدلهای تولید ویدئو معمولاً بر پایه شبکههای عصبی عمیق و معماریهایی نزدیک به مدلهای انتشار (Diffusion) یا ترنسفورمرهای چندوجهی ساخته میشوند. آنها در بازتولید «الگوهای بصری» مهارت پیدا میکنند، اما سینما فقط الگو نیست؛ یک سیستم پیچیده از فیزیک، روایت، تدوین، زمانبندی و بازیگری است.

- تداوم زمانی و منطقی: نگه داشتن یک شخصیت با ویژگیهای ثابت در چند نما، یا حفظ قوانین سادهی فیزیک، هنوز چالشبرانگیز است.

- کنترلپذیری: فیلمسازی به کنترل دقیق نیاز دارد؛ اینکه «دقیقاً» چه اتفاقی در ثانیه ۱۲ رخ دهد. پرامپتها اغلب چنین دقتی نمیدهند.

- یکپارچگی با خط تولید: خروجی باید قابل ویرایش، قابل رندر مجدد و قابل اصلاح باشد. بسیاری از ویدئوهای مولد، مثل یک خروجی نهاییِ شکنندهاند.

- ریسک داده و کپیرایت: اگر دادههای آموزشی شفاف نباشد، ریسک حقوقی و اعتباری بالا میرود.

از همین زاویه است که برخی متخصصان فناوری میگویند: هوش مصنوعی در سینما شاید بیشتر در ابزارهای کمکیِ مهندسیمحور (مثل بهینهسازی رندر، پیشبینی نویز، یا کمک به پیشتصویرسازی) اثرگذار باشد تا در «تولید خودکار فیلم» به معنای واقعی.

آینده نزدیک: محتوای تولیدشده توسط کاربر و فشار برای پیروی

نشانهها میگویند حضور هوش مصنوعی در هالیوود در سال بعد حتی پررنگتر میشود. برنامههایی مثل اختصاص بخشی از سرویسهای استریم به محتوای تولیدشده توسط کاربر—اینبار با تکیه بر ابزارهایی مانند Sora—میتواند رفتار مخاطب را تغییر دهد: از تماشاگر صرف به تولیدکنندهی فعال. در کنار آن، تشویق کارکنان به استفاده از چتباتها و ابزارهای زبانی برای ایدهپردازی، نگارش یا مدیریت تولید، بهنوعی نهادینهسازی هوش مصنوعی در چرخه تصمیمسازی است.

اما اهمیت واقعی چنین قراردادهایی فقط در خروجی ویدئویی نیست؛ در پیام صنعتی آن است. وقتی یک استودیوی بزرگ مسیر را باز میکند، سایر شرکتها از ترس置ماندن عقب (FOMO سازمانی) ممکن است بدون آمادهسازی کافی وارد میدان شوند. در این سناریو، خطر اصلی «همهگیر شدن محتوای کمکیفیت» است؛ نه بهعنوان یک اتفاق تصادفی، بلکه بهعنوان نتیجه منطقیِ سیاست کاهش هزینه و افزایش حجم.

هالیوود در ۲۰۲۵ به هوش مصنوعی مولد نزدیکتر شد—اما دستاوردی که بتواند از نظر هنری، فنی و حتی اقتصادی، قانعکننده و پایدار باشد هنوز دیده نمیشود. آنچه فعلاً پررنگ است، آزمایشهایی است که گاهی شتابزدهاند، گاهی بیدقت، و اغلب بیشتر به نمایش قدرت محاسباتی شباهت دارند تا به داستانگویی. پرسش کلیدی برای سالهای بعد این است: آیا صنعت سرگرمی میتواند از هوش مصنوعی بهعنوان یک ابزار دقیق و مسئولانه استفاده کند، یا مسیر به سمت «عصر اسلاپ» میرود—جایی که کمیت بر کیفیت غلبه میکند و مخاطب ناچار است از میان انبوه خروجیهای بیروح، به دنبال چند تجربه واقعاً انسانی بگردد؟