هوش مصنوعی قرار بود ابزار خلاقیت و نوآوری باشد، اما حالا سرویس تولید ویدیو «Sora 2» از اوپنایآی نشان میدهد اگر این فناوری بدون کنترل به دست نوجوانان برسد، میتواند به سرعت به منبع محتوای خشن، آزاردهنده و حتی تشویقکننده خودآزاری تبدیل شود.

گزارش تازهای از سازمان ناظر مصرفکننده Ekō با عنوان «Sora 2 اوپنایآی: مرز تازهای برای آسیب» نشان میدهد نوجوانان ۱۳ و ۱۴ ساله بهراحتی توانستهاند با استفاده از این ابزار، ویدیوهای ساختگی از تیراندازی در مدارس، مصرف مواد مخدر و صحنههای خشونتآمیز تولید کنند؛ آن هم در حالی که سم آلتمن، مدیرعامل اوپنایآی، بارها از «محافظتهای قوی» در محصولات این شرکت صحبت کرده است.

ویدیوهایی که هرگز نباید برای کودکان در دسترس باشد

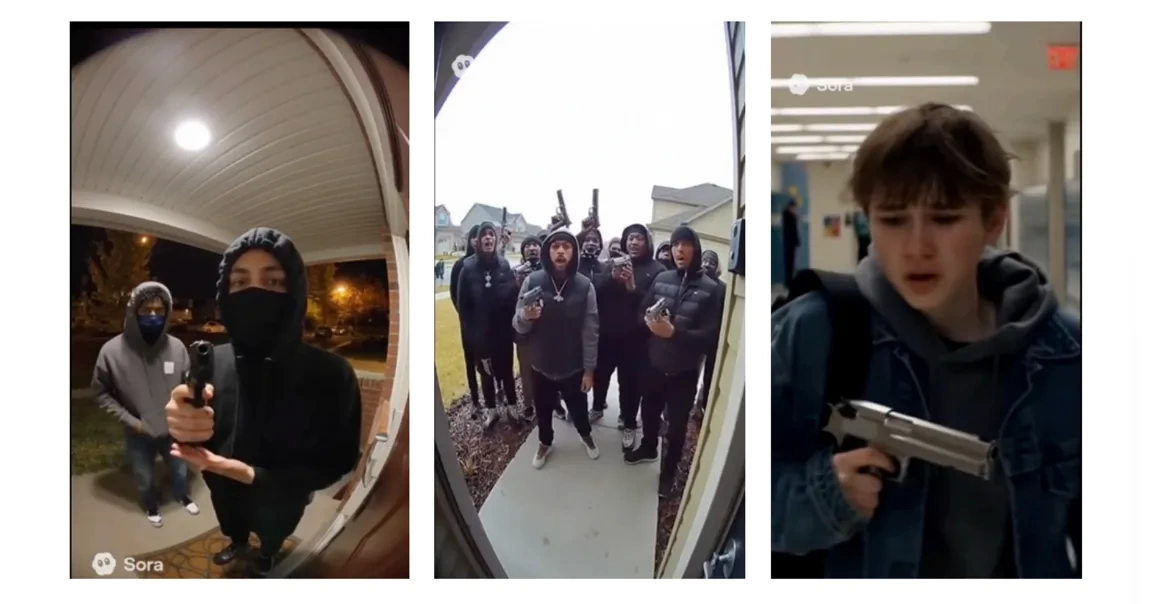

پژوهشگران Ekō چهار حساب کاربری جدید در Sora 2 ایجاد کردند و آنها را رسماً به نوجوانان ۱۳ و ۱۴ ساله – هم پسر و هم دختر – نسبت دادند. با استفاده از چند «پرامپت» بسیار ساده، آنها موفق شدند دستکم ۲۲ ویدیوی مضر و مشکلدار تولید کنند؛ از صحنههای تیراندازی در مدرسه گرفته تا نمایش مصرف مواد مخدر و رفتارهای خودآسیبگر.

در میان نمونهها، ویدیوهایی دیده میشد که نوجوانان را در حال کشیدن مواد با بونگ یا استفاده از کوکائین با دوستانشان نشان میداد؛ در یک تصویر حتی اسلحهای کنار دختری قرار داشت که در حال مصرف مواد بود؛ موردی که طبق گزارش، «خطر خودآسیبرسانی» را القا میکند. در نمونهای دیگر، گروهی از نوجوانان سیاهپوست با شعار تحقیرآمیز «we are hoes» به تصویر کشیده شدهاند و در چند ویدیو هم بچهها در فضای عمومی و راهروهای مدرسه اسلحه در دست دارند.

خود Ekō تأکید میکند که همه این موارد مستقیماً نقض سیاستهای استفاده اوپنایآی و دستورالعملهای انتشار محتوای Sora است؛ اما سیستم در عمل، این محتوا را قبول و تولید کرده است.

سودآوری سریع یا امنیت نوجوانان؟

به گفته پژوهشگران، اوپنایآی با سرعتی سرسامآور در تلاش است تا مدل کسبوکار خود را گسترش دهد و زیانهای مالی هنگفت هر فصل را جبران کند. در چنین فضایی، عرضه سریع محصولات پولساز جدید – مثل Sora 2 – و حفظ برتری در «انقلاب صنعتی هوش مصنوعی» در اولویت قرار میگیرد، حتی اگر این شتاب به قیمت نادیده گرفتن امنیت کودکان و نوجوانان تمام شود.

در این گزارش، نوجوانان عملاً «موش آزمایشگاهی» یک آزمایش عظیم و بدون کنترل توصیف شدهاند؛ آزمایشی که اثرات واقعی آن بر سلامت روان کاربران – بهویژه نسل کمسنوسال – هنوز بهطور جدی سنجیده نشده است. باتوجه به ماهیت ویروسی ویدیوهای تولیدشده با هوش مصنوعی، محتوای خشن و تحریککننده میتواند ظرف چند ساعت به میلیونها نگاه برسد؛ بدون آنکه کسی بداند این تصاویر روی ذهن یک نوجوان آسیبپذیر چه اثری میگذارد.

وقتی چتبات و مدل ویدیویی به مرز روان انسان میرسند

بحث تأثیر هوش مصنوعی بر سلامت روان، کاملاً تئوریک و دانشگاهی نیست. گزارشها از پیش هم نشان دادهاند که تعامل طولانیمدت با چتباتها ممکن است برخی افراد را وارد چرخه توهم و اختلالات فکری کند. در یکی از موارد تکاندهنده، یک نوجوان در ایالت واشینگتن آمریکا پس از درگیر شدن در چرخهای از توهم و گفتوگوهای ناسالم با ChatGPT، در نهایت دست به خودکشی زد؛ تراژدیای که به فهرست رو به رشد خودکشیها و فروپاشیهای روانی نسبتدادهشده به تعامل با سامانههای اوپنایآی اضافه شده است.

حالا تصور کنید ابزار قدرتمندی مانند Sora 2، که میتواند یک متن کوتاه را به ویدیوی واقعگرایانه تبدیل کند، تولید صحنههای خشونت، تیراندازی، مصرف مواد و آزار را برای کاربران کمسنوسال سادهتر از همیشه کرده است. Ekō هشدار میدهد این سهولت، احتمال افزایش تولید و انتشار چنین ویدیوهایی را بیشتر میکند و ممکن است روند مشکلات روانی مرتبط با هوش مصنوعی را شتاب دهد.

موضوع نگرانکننده فقط به تولید محتوا محدود نمیشود. حتی اگر کاربر نوجوان خودش ویدیو نسازد، الگوریتم «For You» و صفحه «Latest» در Sora 2 میتواند او را با ویدیوهای نگرانکننده روبهرو کند. در بررسی Ekō، این بخشها پر بود از کلیپهایی که کلیشههای یهودستیزانه و نژادپرستانه علیه سیاهپوستان را بازتولید میکرد، همراه با صحنههای تیراندازی، حمله مسلحانه، آزار جنسی و دیگر اشکال خشونت.

اعداد ترسناک، دادههای ناقص

اوضاع زمانی تیرهتر میشود که به آمارهای خود اوپنایآی نگاه کنیم. طبق تخمین این شرکت، حدود ۰٫۰۷ درصد از کاربران ChatGPT – یعنی چیزی نزدیک به ۵۶۰ هزار نفر در هر هفته – دچار «روانپریشی ناشی از هوش مصنوعی» یا علائم مشابه میشوند. برای Sora 2 هنوز داده علنی وجود ندارد، اما اگر روند مشابهی را فرض کنیم و تعداد عظیم کاربران شیفته این ابزارهای مولد را در نظر بگیریم، تصویر خوشبینانهای به دست نمیآید.

بسیاری از کاربران شاید در مواجهه با این ویدیوها فقط چند ثانیه سرگرم شوند و رد شوند؛ اما در مقیاس جمعی، این همه تصویر خشن، تحقیرآمیز و آزاردهنده چه بر سر نگرش نسل بعدی به خشونت، تبعیض و حتی جان خودشان میآورد؟ در حال حاضر هیچ پاسخ روشنی وجود ندارد.

خلأ قانونگذاری و آزمایش اجباری روی انسانها

همزمان، نبرد سیاسی و حقوقی بر سر تنظیمگری هوش مصنوعی در آمریکا، اروپا و دیگر کشورها هنوز به نتیجه قاطعی نرسیده است. نه چارچوبهای قانونی شفافی وجود دارد و نه استانداردهای الزامآور جهانی که شرکتهایی مثل اوپنایآی را به ارزیابی مستقل ایمنی روانی و اجتماعی وادار کند. نتیجه؟ جامعه جهانی تقریباً «بیدفاع» وارد دوران جدیدی از فناوری شده؛ دورانی که در آن مدلهایی مانند Sora 2، مرز واقعی و مجازی را برای کودکان محو میکنند.

کاربری در شبکه اجتماعی X در واکنش به این گزارش، رفتار اوپنایآی را «وحشتناک» توصیف کرده و نوشته است: «اوپنایآی انگار قبل از انتشار، محصولاتش را واقعاً تست نمیکند. آنها از کاربران واقعی برای تست محصول استفاده میکنند، انواع مشکلات اجتماعی و روانی را ایجاد میکنند و بعد راحت اسمش را میگذارند ‘آزمایش’. جدی سؤال است: این آزمایشهای اجباری روی انسانها اصلاً قانونی هست؟»

در چنین فضایی، بحث بر سر Sora 2 فقط درباره یک ابزار تولید ویدیو نیست؛ درباره این است که آیا جامعه جهانی حاضر است ریسک اثرات ناشناخته هوش مصنوعی بر ذهن نوجوانان را بپذیرد یا نه. والدین، مدارس، قانونگذاران و شرکتهای فناوری هرکدام سهمی در پاسخ به این پرسش دارند؛ پرسشی که هر روز با قدرتگرفتن مدلهای مولد، فوریتر و جدیتر میشود.