تصور کنید در حال دیدن کلیپی هستید که در آن دو سیاستمدار روبروی یکدیگر نشستهاند و در حال مذاکرهاند. همه چیز طبیعی است، دیالوگها، محیط. هرچیزی که میبینید واقعی است و تصمیم میگیرید آن را با یکی از دوستان خود به اشتراک بگذارید؛ دوست شما آن را به افراد دیگری میفرستد و همینطور این چرخه ادامه پیدا میکند و همینطور ویدئو دست به دست میشود. پس از مدتی متوجه میشوید که هر دو فرد حاضر در جلسه در واقعیت آنجا نبودهاند و صورت آنها روی صورت فرد دیگری گذاشته شده است و این ویدئو اصلا واقعی نیست. این اتفاق به وسیله فناوری دیپ فیک میسر شده است.

دیپ فیک چیست؟

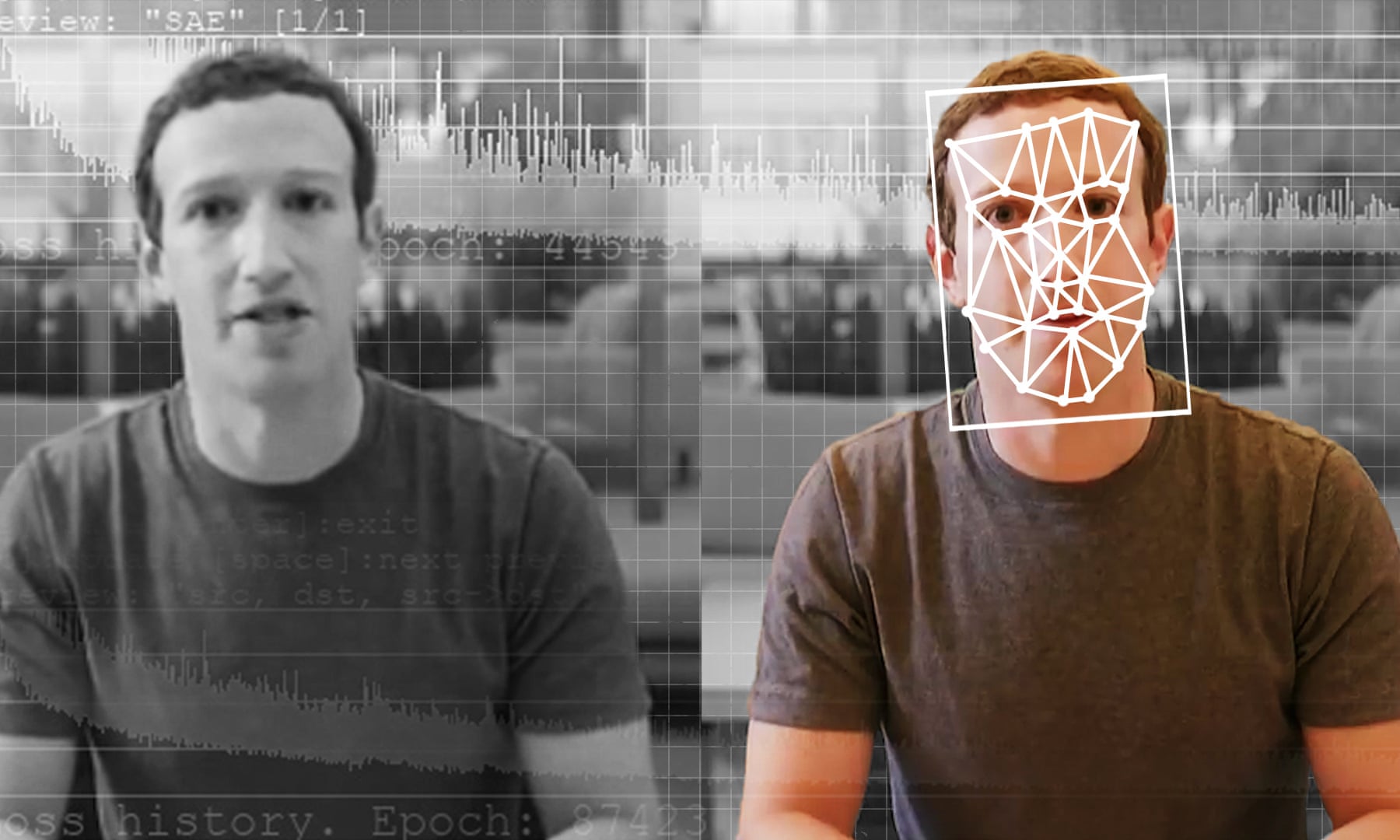

فناوری دیپ فیک اولین بار در سال ۲۰۱۴ توسط «یان گودفلو»، یک دانشجوی دکترا که هماکنون در اپل مشغول به کار است به وجود آمد. دیپ فیک بیشتر مبتنی بر شبکههای مولد تخاصمی (GAN) است. شبکههای مولد تخاصمی الگوریتمها را قادر میسازند تا برای تولید یا ایجاد تصاویر، فراتر از طبقهبندی دادهها بروند. این اتفاق زمانی رخ میدهد که دو GAN تلاش کنند تا یکدیگر را گول بزنند و تصور کنند که یک تصویر «واقعی» است. یک GAN میتواند فقط با استفاده از یک تصویر فردی خاص، یک کلیپ ویدئویی کامل از او ایجاد کند.

مرکز هوش مصنوعی سامسونگ اخیرا تحقیقی منتشر کرده که دانش پشت فناوری دیپ فیک را فاش میکند. در بخشی از تحقیق آمده: «برای ایجاد یک مدل واقعی از سر یک فرد در حال صحبت، نیاز به یادگیری مجموعهای داده دریافت شده از تصاویر صورت آن شخص است. با این حال، در بسیاری از سناریوهای عملی، مانند مدلهای شخصی شده افراد در حال صحبت، نیاز به چندین یا حتی یک تصویر از صورت آن فرد بوده است.»

برای آشنایی بیشتر ویدئوی زیر را مشاهده کنید. در این ویدئو دیپ فیک که توسط کاربری یوتیوبی به نام Ctrl Shift Face ساخته و منتشر شده و از زمان انتشار تاکنون بیش از ۱۰ میلیون بازدید داشته کمدین معروف «بیل هدر» در یک برنامه تلویزیونی شرکت کرده و شروع به تعریف خاطرهای که با تام کروز داشته میکند. همزمان که او شروع به تقلید صدای تام کروز و ست روگن میکند، صورت او تغییر کرده و کاملا شبیه تام کروز و ست روگن میشود!

در حال حاضر تکنولوژی دیپ فیک فقط محدود به صورتهای در حال صحبت است؛ اما اگر این تکنولوژی پیشرفت کرده و بتواند تمامی اجزای یک فرد زنده را شبیهسازی کند چه؟ همین حالا هم به راحتی نمیتوان ویدئوی دیپ فیک را از ویدئوی واقعی تشخیص داد. حالا ببینید با پیشرفت آن چه اتفاقی خواهد افتاد.

چرا دیپ فیک خطرناک است؟

با توجه به این مسئله که اکنون دیگر کمتر کشوری به دنبال خرج هزینههای گزاف برای حمله نظامی به دشمنان خود است و اکثرا به جنگ سایبری روی آوردهاند؛ میتوان خطری که از جانب دیپ فیک ممکن است متوجه دولتها باشد را بیشتر درک کرد. همچنین در نظر بگیرید که میتوان یکی از عکسهای اشخاص شناخته شده مانند بازیگران، سیاستمداران یا حتی مردم معمولی را روی ویدئوهای مختلف و مسهجن قرار دهند! یا حتی با استفاده از این تکنولوژی کاری کنند تا سیاستمداران و رهبران جنگی به نیروهای خود دستور حمله به کشور خاصی را بدهند یا خشونت را ترویج کنند.

آندره هیکرسون، مدیر دانشکده روزنامهنگاری و ارتباطات جمعی دانشگاه کارولینای جنوبی میگوید: «دیپ فیک به بیان ساده دروغی است که مبدل به حقیقت میشود. اگر آنها را حقیقت در نظر بگیریم میتوانیم تصمیماتی نادرست با پیامدهای ناگوار بگیریم.»

هیکرسون در ادامه میگوید: «بیشتر ترس مربوط به دیپ فیک در مورد سیاست است. چه اتفاقی میافتد اگر ویدئویی منتشر شود که یک رهبر سیاسی را در حال ترویج خشونت یا وحشت نشان دهد؟ اگر این تهدید فوری باشد، ممکن نیست کشورهای دیگر مجبور به اقدام شوند؟»

بن لام، مدیرعامل شرکت هوش مصنوعی Hypergiant Industries میگوید: «مشکل لزوما تکنولوژی GAN نیست. مسئله این است که در حال حاضر بازیگران بد از یک مزیت بزرگ (دیپ فیک) استفاده میکنند و هیچ راهحلی برای حل این تهدید روبهرشد وجود ندارد. با این حال، تعداد و راهحل ایدههای جدید در دنیای هوش مصنوعی برای مقابله با این تهدید در حال ظهور است؛ اما هنوز راهحل اول انسانها هستند.»

در کشورهای مختلف از دیپ فیک برای ایجاد بیثباتی در دولتها و روندهای سیاسی استفاده شده است. در زیر چند مورد از آنها را مرور میکنیم:

- در گابون، پس از انتشار ویدئویی ظاهرا جعلی از رهبر آنها «علی بونگو» که اعلام میکرد رئیس جمهور آنها دیگر از سلامتی کافی برای اداره کشور برخوردار نیست، ارتش کودتایی نافرجام را آغاز کرد.

- در مالزی، ویدئویی منتشر شد که در آن وزیر اقتصاد مالزی را در حال رابطه جنسی نشان میداد. بحث و جدلهایی که پیرامون جعلی بودن یا نبودن این فیلم راه افتاده شهرت این وزیر را خدشهدار کرده است.

- در بلژیک، یک گروه سیاسی دیپ فیکی از نخست وزیر بلژیک پخش کرد که در آن او طی یک سخنرانی شیوع ویروس کرونا را به آسیبهای زیست محیطی ربط داد و خواستار اقدام سریع در مورد تغییرات اقلیمی شد.

انتخابات آمریکا تمام شده و رئیس جمهور این کشور نیز مشخص شده است؛ اما قبل از انتخابات زمزمههایی مبنی بر استفادههایی از دیپ فیک برای اخلال در این انتخابات میشد. تابستان سال گذشته، کمیته اطلاعات مجلس نمایندگان ایالاتمتحده تامهای مشترک به توییتر، فیسبوک و گوگل ارسال کرد و از آنها پرسید که رسانههای اجتماعی برای مبارزه با دیپ فیک در انتخابات این کشور چه برنامهای دارند؟ این تحقیق بعد از ویدئوی جعلی سخنگوی محلس نمایندگان که ترامپ توییت کرده بود ناجام گرفت:

حالا تصور کنید که اگر هریک از کاندیداها برای تخریب رقیب یا بالا بردن رای خود از دیپ فیک استفاده کرده باشند چه اتفاقی میافتد؟ البته با جستجوهایی که انجام دادم فعلا خبری در این رابطه منتشر نشده. شاید در آیندهای نهچندان دور جواب این سوال مشخص شود.

قانون در این رابطه چه میگوید؟

دیپ فیک غیرقانونی نیست؛ اما تولیدکنندگان و توزیعکنندگان میتوانند به راحتی با آن از قانون سرپیچی کنند. یک دیپ فیک بسته به محتوایی که دارد میتواند حق کپی رایت یا قانون حفاظت از محتوا را نقض کند و اگر قربانی را مورد تمسخر قرار دهد، میتواند افترا آمیز باشد. همچنین ممکن است جرم کیفری اشتراک تصاویر جنسی و خصوصی بدون اجازه شخص شامل آن شود. در انگلیس قانون در مورد این مسئله تفکیک شده است و در اسکاتلند قانون انتقام جنسی شامل دیپ فیک نیز میشود.

راهحل مقابله با تهدیدها چیست؟

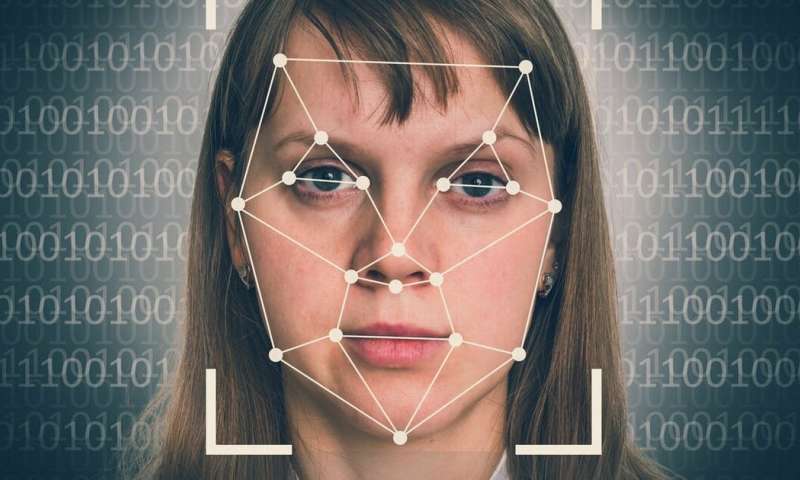

راستش را بخواهید به نظرم هوش مصنوعی میتواند بهترین روش باشد؛ اما بسیاری از سیستمهای هوش مصنوعی تشخیص فعلی ضعف جدی بزرگی دارند. آنها میتوانند افراد مشهور را خوب تشخیص دهند؛ چون آزادانه به ساعتها فیلم واقعی از آنها دسترسی دارند. در حال حاضر شرکتهای فناوری در حال کار کردن روی سیستمهای ردیابی هستند که هر زمان که ویدئوی تقلبی ظاهر شد آن را تشخیص دهند. روش دیگر تمرکز روی منشا رسانه است. واترمارکهای دیجیتالی بدون ایراد نیستند؛ اما یک منبع آنلاین بلاکچین میتواند سابقهای از نسخه اصلی فیلمها در خود داشته باشد تا بتوان منبع و منشا آنها برای تشخیص نسخه تقلبی دسترسی داشت.

آیا دیپفیک همیشه خطرناک است؟

نه لزوما؛ بسیاری از آنها سرگرمکننده و بعضی نیز مفید هستند. دیپ فیکهای صدا میتوانند وقتی شخصی از دست رفته، صدای او را برگرداند. فیلمهای دیپفیک میتوانند گالریها و موزهها را زنده کنند. موزه «سالوادور دالی» دیپ فیکی از این نقاش سورئالیست دارد که خود را معرفی و حتی با بازدیدکنندگان عکس سفلی هم میگیرد. در صنعت سرگرمی میتوان از این فناوری در بهبود دوبله فیلمها یا حتی زنده کردن بازیگران از دنیا رفته استفاده کرد. برای مثال، «جیمز دین» فقید قرار است در فیلمی به نام «Finding Jack» که مربوط به جنگ ویتنام است بازی کند.

نتیجهگیری

به نظر من هر چیزی ممکن است هم مضر باشد و هم مفید. یک چاقو میتواند هم برای کشتن کسی استفاده شود و هم برای راحتتر کردن کار ما برای اینکه همیشه با دست میوهها را پوست نکنیم. در مورد دیپ فیک هم همین مسئله صدق میکند؛ اما چیزی که من دیدم این است که استفاده نابجا از این تکنولوژی بیشتر از استفاده درست آن است و قابلیت استفاده خلاف از آن بیشتر از استفاده مناسب است.

این مسئله را هم در نظر بگیرید که در دنیایی که چند دقیقه بعد از انتشار یک ویدئو در اینترنت ممکن است میلیونها نفر (البته توسط فردی شناخته شده یا اینفلوئنسرها) آن ویدئو را مشاهده میکنند، اگر آن فیلم تقلبی و دیپ فیک از آب درآمد چه کار باید کرد؟ قطعا طی همان چند دقیقه چندین و چندبار آن ویدئو به اشتراک گذاشته شده و کاملا به صورت شبکهای و تصاعدی بازدید آن بیشتر میشود. در این شرایط ما ایرانیها ضربالمثلی داریم که میگوییم «آب رفته رو دیگه نمیشه جمع کرد». دیگر هیچکاری از دست کسی برنمیآید و حتی اگر در صدد رفع سوءتفاهم پیش آمده بر بیایید هم نمیتوان به طور کامل مشکل را رفع و رجوع کرد.

شما چه فکری میکنید؟ آیا دیپ فیک مفید است یا مضر؟ نظرات خود را با ما و دیگر دوستانتان در آیتیرسان به اشتراک بگذارید.

چه دیپ فیکی بیان از *********** هم دیپ فیک بسازن

اگه تو همه کشورها یه سیستم انسان سازی و اموزشی مثل ژاپن بود این همه ادم سو استفاده کن و حرومزاده تو دنیا به وجود نمیامد که با ورود هر تکنولوژی یا هر چیز دیگه نگران استفاده بد از اون باشن و الان مردم کشور خودمون رو ببین 80 درصدش باید برن زیر خاک و این مردم تمامن فاسد شدن و بدرد کود شدن هم نمیخورن حتی

عموما از نظر بعضیا همه فن اوریا در دست مردم خطرناکن! در دست بعضیا فقط خوبه! ولی من موندم واقعا فک میکنین اون رهبران با یه فیلم دیپ فیک دستور حمله نظامی میدن؟ بابا ته استدلال بود این :))

دوست عزیز مردم عادی که چیزی از این فناوری نمیدونن ممکنه دستور حمله یا هرچیزی مخالف روند همیشگی اون رهبران رو باور کنن. کمی مطلب رو اشتباه برداشت کردید. رهبران با دیپ فیک هیچکس دستور حمله نمیدن، روی صورت رهبران دیپ فیک رو اجرا میکنن تا به افراد عادی دستور حمله بدن. مثالهاش هم توی متن با رفرنس اصلی هست. میتونید مشاهده کنید.